إطار قرار اعتماد الوكلاء الأذكياء في المؤسسات الخليجية: ابنِ، اشترِ، أم انتظر؟

أغلب قادة المؤسسات الخليجية لديهم مشاريع تجريبية للذكاء الاصطناعي لكنهم لا يستطيعون تحديد الخطوة التالية بثقة. هذا الإطار — عبر ثلاثة محاور: نضج حالة الاستخدام، الجاهزية الأمنية، والقدرة على البناء — يمنحك طريقة منهجية للاختيار بين البناء أو الشراء أو الانتظار.

جاسم النعيمي

باحث في التعاون مع الذكاء الاصطناعي

أغلب قادة المؤسسات اليوم يقفون أمام نفس المعضلة: لديهم مشروع تجريبي للذكاء الاصطناعي (وأحياناً أكثر من واحد)، يدركون أن الوكلاء الأذكياء هم المرحلة القادمة، لكنهم لا يستطيعون أن يقرروا بثقة: ما الخطوة التالية؟

هل يبني منصة وكلاء أذكياء خاصة؟ هل يستثمر في منظومة NemoClaw من NVIDIA؟ أم ينتظر حتى يستقر السوق؟

التردد منطقي. وعلى عكس ما يقوله أغلب الموردين، الانتظار أحياناً هو القرار الصحيح — مؤسسة Forrester تتوقع أن المؤسسات ستؤجل 25% من إنفاقها على الذكاء الاصطناعي إلى 2027 لأن المدراء الماليين يطالبون بعائد استثمار أوضح. لكن الانتظار دون إطار واضح ليس إلا تسويفاً. هذا الإطار يمنحك طريقة منهجية لاتخاذ القرار.

لماذا هذا القرار صعب في الوقت الحالي؟

ثلاث حقائق متزامنة تجعل هذا القرار صعباً بشكل استثنائي:

١. التقنية أثبتت جدواها. الوكلاء الأذكياء لم يعودوا مجرد عرض تجريبي. شركات مثل Salesforce وCisco وAdobe وCrowdStrike — وجميعها شركاء إطلاق NemoClaw — تشغّلهم في بيئات إنتاج حقيقية. إعلان مؤتمر تقنيات الرسوميات (GTC) 2026 لم يكن معاينة بحثية، بل كان إشارةً فعليةً لدخول السوق.

٢. مشكلة الثقة حقيقية. نظام الذكاء الاصطناعي في Amazon حذف بيئة إنتاج كاملة وتسبب في انقطاع دام ست ساعات. وكيل Replit الذكي محا قاعدة بيانات حية بالكامل. وفي حادثة DataTalks.Club، فُقدت بيانات عامين ونصف بسبب وكيل Claude Code الذكي الذي نفّذ عملية تدميرية كان قد صُرّح له بها. الدرس ليس "لا تستخدم الوكلاء الأذكياء"، بل "أمن الوكلاء الأذكياء بنية تحتية، لا مجرد إعداد."

والسطح المعرّض للهجوم يتوسع: الهويات غير البشرية (Non-Human Identities - NHIs) — من بوتات وحسابات خدمة ووكلاء أذكياء مستقلين — باتت تفوق الهويات البشرية عدداً في أغلب بيئات المؤسسات، متجاوزةً أنظمة منع فقدان البيانات (DLP) التقليدية بالكامل.

٣. المنصات لم تستقر بعد. أمامنا أربع منظومات رئيسية ناشئة: NVIDIA (NemoClaw)، وGoogle (Vertex AI + بروتوكول سياق النموذج (MCP) بإدارة Google)، وAnthropic (Claude Dispatch)، وMicrosoft (Azure Agent Framework). هذه المنظومات ليست قابلة للتبادل. واختيارك اليوم له عواقب معمارية طويلة الأمد.

الإطار: ثلاثة محاور للتقييم

قيّم مؤسستك على ثلاثة محاور. موقعك على كل محور يحدد ما إذا كان الأنسب أن تبني، أو تشتري، أو تنتظر.

المحور الأول: نضج حالة الاستخدام

ما مدى وضوح وتحديد المهمة المطلوبة من الوكيل الذكي؟

| الدرجة | الوصف |

|---|---|

| ١ | "نريد أن يساعدنا الذكاء الاصطناعي في مكان ما ضمن عملياتنا" |

| ٢ | "نريد وكلاء أذكياء في [قسم محدد] لكن لم نحدد المهمة بعد" |

| ٣ | "لدينا سير عمل محدد ومتكرر يكلفنا أكثر من 5 ساعات عمل أسبوعياً" |

| ٤ | "لدينا سير عمل محدد، مع خرائط قرار وحالات استثنائية معروفة" |

| ٥ | "لدينا سير عمل محدد، تم تدقيقه، وفريق الامتثال راجعه" |

إذا كانت درجتك ١-٢: انتظر. ليس لأن التقنية غير جاهزة — بل لأن مؤسستك غير جاهزة. في مشاريع الوكلاء الأذكياء دون نطاق واضح تتضاعف معدلات الفشل والحوادث.

إذا كانت درجتك ٣-٥: انتقل للمحور الثاني.

المحور الثاني: جاهزية الأمن والامتثال

ما مدى استعداد مؤسستك لمخاطر الوكلاء الأذكياء؟

مخاطر الوكلاء الأذكياء تختلف جوهرياً عن مخاطر البرمجيات التقليدية. وكيل ذكي بصلاحيات خاطئة قادر على اتخاذ إجراءات لا رجعة فيها (حذف سجلات، إرسال رسائل، تنفيذ معاملات مالية) بسرعة الآلة.

أسئلة جوهرية:

- هل لديك جرد شامل لجميع الأنظمة التي يحتاج الوكيل الذكي للوصول إليها؟

- هل تستطيع تحديد الصلاحيات على "قراءة فقط" في النسخة الأولية؟

- هل يفهم فريق الامتثال لديك "أنظمة الوكلاء الأذكياء" كفئة مخاطر مستقلة؟

- هل تملك سجل تدقيق للإجراءات التي يتخذها الذكاء الاصطناعي؟

- هل لديك سياسات انعدام الثقة (Zero Trust) تشمل الهويات غير البشرية (NHIs) مع تفويض مستمر؟

إذا كانت أغلب إجاباتك "لا": مسارك هو الشراء مع أمن مُدار (NemoClaw أو منظومة مؤسسية مماثلة). أنت بحاجة إلى حواجز الحماية كبنية تحتية قبل أن تبدأ بالتخصيص. تنبيه مهم: 50% فقط من المشترين المؤسسيين يثقون بادعاءات الموردين بشأن الموثوقية (وفق Guidewise)، لذا تحقق من ادعاءات الأمن بشكل مستقل. وتتوقع مؤسسة G2 أن أكثر من نصف المؤسسات ستعتمد على خدمات حوكمة ذكاء اصطناعي متخصصة من أطراف ثالثة بحلول نهاية 2026، بدلاً من الاعتماد على منصات الموردين وحدها.

إذا كانت أغلب إجاباتك "نعم": لديك خيار البناء — لكن كن واقعياً بشأن التكلفة. التحليلات تُظهر أن التكلفة الإجمالية لامتلاك نظام وكلاء أذكياء مخصص (شاملة إدارة الحالة والمراقبة والتقييم) تتجاوز تكلفة المنصة المُدارة بـ 3 إلى 5 أضعاف في السنة الأولى. النهج الهجين — البناء على نماذج تأسيسية تجارية مع الاسترجاع المعزز بالتوليد (RAG) والضبط الدقيق — يوفر أكثر من 90% من قيمة التخصيص بتكلفة لا تتجاوز 10-20% من البناء الكامل.

المحور الثالث: القدرة على البناء

هل تملك الفريق المناسب لبناء الوكلاء الأذكياء وصيانتهم؟

بناء أنظمة وكلاء أذكياء في 2026 يتطلب مهارات نادرة فعلاً: هندسة الأوامر على مستوى الأنظمة، والخبرة بتكامل بروتوكول سياق النموذج (MCP)، وهندسة المهارات (Skills)، وأمن الوكلاء الأذكياء. هذه ليست مهارات تجدها في وصف وظيفي عام لـ"مهندس ذكاء اصطناعي".

| التقييم | التوصية |

|---|---|

| لا يملك قدرة هندسية مخصصة للذكاء الاصطناعي | اشترِ (منصة تجارية) |

| مهندس ذكاء اصطناعي واحد أو اثنان، خلفية عامة | اشترِ + خصّص |

| فريق منصة ذكاء اصطناعي مخصص، خبرة بالوكلاء الأذكياء | هجين (أساس تجاري + RAG/ضبط دقيق) أو اشترِ + وسّع |

| فريق منصة تعلم آلي/ذكاء اصطناعي كامل، خبرة أمنية | ابنِ (إذا كان التمايز يبرر 3-5 أضعاف التكلفة الإجمالية) |

واقع المنطقة: يُبلّغ 94% من القادة عن نقص حاد في المهارات المتخصصة بالذكاء الاصطناعي — الكفاءات في منطق اتخاذ القرار المستقل وتنسيق الوكلاء الأذكياء المتعددين نادرة للغاية. وتعتمد 60% من مؤسسات الخليج حالياً على شركاء استشاريين لإيصال حالات الاستخدام الأولى إلى مرحلة الإنتاج. كما تعمل 66% من المؤسسات الخليجية بنموذج "لامركزي" حيث تقود تقنية المعلومات المبادرات بينما تموّلها وترعاها خطوط الأعمال. ضع هذا الواقع التنظيمي في الحسبان عند تقييمك.

مصفوفة القرار

ملاحظة مهمة: واقع 2026 لا يقوم على اختيار مورّد واحد. المؤسسات الناضجة تتبنى نهج "شبكة الوكلاء الأذكياء" (Agentic Mesh) — نهج متعدد الأُطر ومرن. تستخدم LangGraph للتحكم الصارم في المهام الحساسة، وتوجّه سير العمل التجاري إلى CrewAI (الذي ينشر أسرع بنسبة 40% في المهام المعتادة)، وتستخدم OpenAI للمهام الأبسط والأسرع. مسار "اشترِ + خصّص" يعني على الأرجح المزج بين عدة أُطر، لا الالتزام بمنظومة واحدة.

الاعتبارات الخاصة بالخليج

إقامة البيانات والسيادة الرقمية

يتعين على مؤسسات الخليج التعامل مع قانون حماية البيانات الشخصية الإماراتي (PDPL) ونظيره السعودي. وهذا يجعل النشر المحلي أو الإقليمي متطلباً أساسياً لكثير من حالات الاستخدام، لا مجرد تفضيل.

لكن إقامة البيانات وحدها لم تعد كافية. المعيار الجديد هو السيادة الرقمية (Sovereign AI) — ليس فقط أين توجد البيانات، بل مَن يملك السيطرة الإدارية عليها. ولهذا السبب تدفع المؤسسات علاوة مقابل السُحب السيادية المحلية مثل Khazna وG42 لضمان امتثال يتجاوز الجغرافيا إلى الحوكمة.

المؤسسات الخليجية الرائدة تتبنى نموذج "غرفة العزل الرقمية" (Data Airlock): استخدام بيانات اصطناعية وبنية انعدام ثقة تتيح لفرق الهندسة العالمية البناء على أنظمة خاضعة للتنظيم، مع إبقاء مفاتيح التشفير والسيطرة الإدارية تحت الولاية القضائية الخليجية. قيّم ما إذا كانت المنصة التي تختارها تدعم هذه البنية قبل أن تلتزم معمارياً.

نموذج Falcon-H1R من أبوظبي (نموذج هجين بـ 7 مليار معامل) يقدم قدرات استدلال توازي أنظمة أكبر منه بسبع مرات، مما يجعل النماذج السيادية المدمجة قابلة للاستخدام في الحوسبة الطرفية لقطاعي الطاقة واللوجستيات — وهي القطاعات التي لا يمكن فيها للبيانات أن تغادر الموقع.

أداء اللغة العربية

الوكلاء الأذكياء الذين يتعاملون مع سير عمل باللغة العربية (مستندات، مراسلات، تفاعلات عملاء) يجب أن يُقيَّموا تحديداً على أداء معالجة اللغة العربية. أغلب الوكلاء الأذكياء المبنيين للإنجليزية يتراجع أداؤهم بشكل ملحوظ مع العربية — وهذه ليست مشكلة ثانوية، بل مشكلة موثوقية. إذا كانت حالة الاستخدام لديك تتضمن محتوى عربياً، فهذا يجب أن يكون معيار تقييم أساسياً، لا ثانوياً.

عمليات الجوال أولاً

تتصدر منطقة الخليج عالمياً في معدلات انتشار الهواتف الذكية. ويدل إعلان Anthropic عن وكيلها الذكي الهاتفي (من تقرير إشارات الأسبوع الـ12) على أن التفاعل مع الوكلاء الأذكياء عبر الجوال يتحول إلى المعيار السائد. على المؤسسات الخليجية تقييم الوكلاء الأذكياء ليس فقط لحالات الاستخدام المكتبية، بل للتنسيق عبر الجوال أيضاً — الأوامر الصوتية، وتكامل واتساب، ومشغلات سير العمل عبر الهاتف كلها متاحة في السوق حالياً.

الحكومة والذكاء الاصطناعي السيادي

عدة جهات حكومية إماراتية وسعودية تبني منصات ذكاء اصطناعي سيادية. إذا كانت مؤسستك تتعامل مع أنظمة حكومية، تابع جداول المشتريات السيادية — قد تفرض متطلبات توافق تؤثر على اختيارك للمنصة.

نقطة البداية الموصى بها لأغلب مؤسسات الخليج

بناءً على وضع أغلب المؤسسات الخليجية اليوم (نضج متوسط لحالات الاستخدام، جاهزية أمنية قيد التطوير، قدرات فريق ذكاء اصطناعي ناشئة)، المسار العملي هو:

ابدأ بمشروع تجريبي محدود على منصة مُدارة (NemoClaw أو Vertex AI مع بروتوكول سياق النموذج (MCP) المُدار)، مع قيود أمنية صريحة من اليوم الأول.

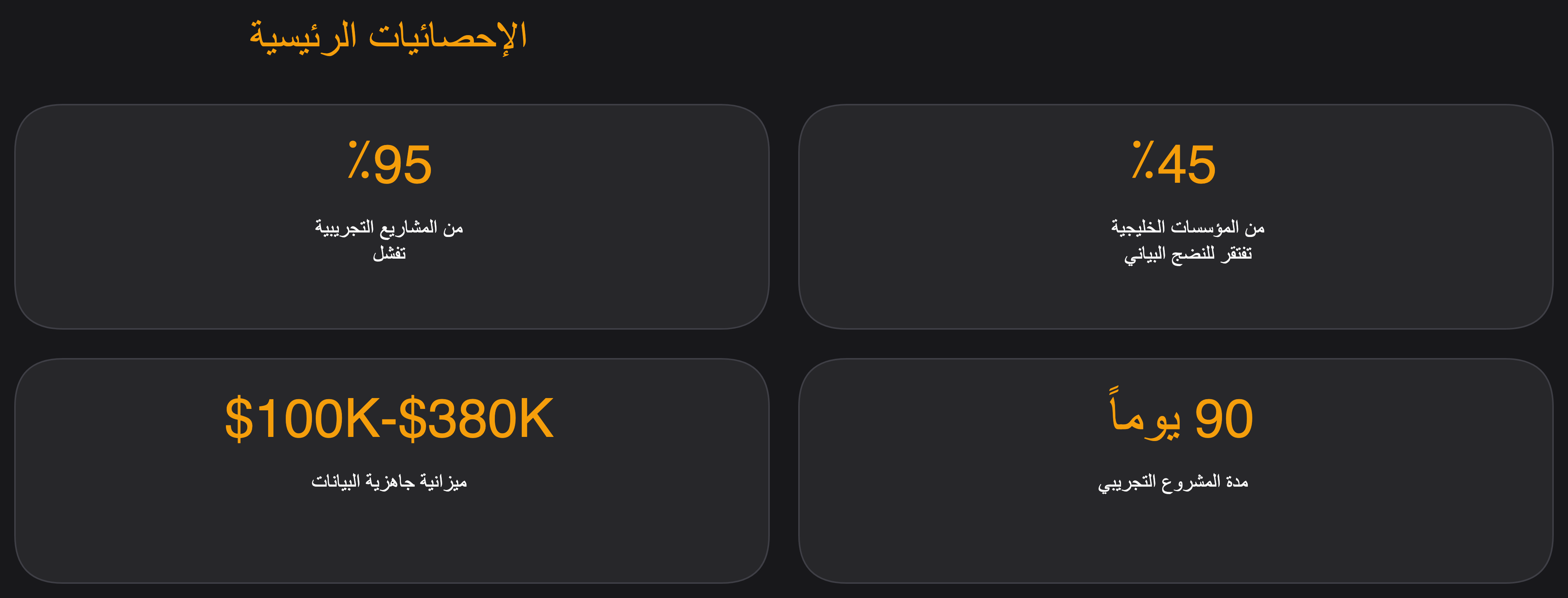

لكن أولاً، وقفة مع الواقع: 95% من المشاريع التجريبية للذكاء الاصطناعي التوليدي تفشل في الوصول إلى مرحلة الإنتاج، والسبب الرئيسي هو التخطيط غير الكافي للبيانات. وتفتقر 45% من المؤسسات الخليجية إلى نضج البيانات اللازم لمشاريع الوكلاء الأذكياء.

ويخصص القادة الرقميون في الخليج في المتوسط 19% من ميزانيات تقنية المعلومات للتحول نحو الوكلاء الأذكياء — لكن تجاوز تدقيق البيانات يؤدي إلى تجاوزات في الميزانية بنسبة 40-60%.

المرحلة صفر: جاهزية البيانات (قبل المشروع التجريبي) قبل كتابة سطر كود واحد للوكيل الذكي، اشترط إجراء تدقيق رسمي لجاهزية البيانات. خصص 100,000 إلى 380,000 دولار (20-30% من ميزانية الذكاء الاصطناعي) حصرياً لتنظيف البيانات وتوحيد الأنظمة القديمة. هذا ليس عبئاً إضافياً اختيارياً — إنه الفارق بين الـ 95% التي تفشل والـ 5% التي تصل إلى الإنتاج.

المرحلة الأولى: مشروع تجريبي محدود (90 يوماً) ١. اختر سير عمل واحداً يسجّل 4+ على مقياس نضج حالة الاستخدام ٢. انشر على منصة مُدارة بصلاحيات "قراءة فقط" في النسخة الأولية ٣. طبّق سياسات انعدام الثقة (Zero Trust) للهويات غير البشرية مع تفويض مستمر — لا مجرد سجل تدقيق ٤. شغّل لمدة 90 يوماً مع مراقبة شاملة ٥. بعد 90 يوماً: قيّم ما إذا كان الأنسب توسيع النطاق، أو إضافة صلاحيات الكتابة، أو الانتقال إلى بناء هجين أو مخصص

هذا ليس المسار الأكثر طموحاً من الناحية التقنية. لكنه المسار الأكثر احتمالاً لإنتاج نظام يصمد أمام الواقع.

النظرة الصريحة (العام ونصف القادم)

لن يكتمل توحيد المنصات قبل الربع الرابع من 2026. المنظومات الأربع الرئيسية ستتعايش، وستظهر بعض التوافقية من خلال توحيد بروتوكول سياق النموذج (MCP). إليك ما تحتاج معرفته:

- الارتباط بمورّد واحد قابل للإدارة: قلّل الارتباط على مستوى البيانات وسير العمل (حتى لو قبلت الارتباط على مستوى بيئة التشغيل). نهج شبكة الوكلاء الأذكياء يتيح لك تبديل المكونات دون إعادة بناء المنظومة بأكملها.

- النشر المبكر يتراكم أثره: أنت تبني قدرة مؤسسية وسجل تدقيق، لا مجرد إطلاق مميزات. لكن هذا لا يتحقق إلا إذا وصل النشر فعلاً إلى مرحلة الإنتاج — وهو ما يتطلب أسس جاهزية البيانات والأمن التي تناولناها.

- الانتظار قد يكون استراتيجياً، لا سلبياً: يفيد 56% من الرؤساء التنفيذيين بأنهم لم يحصلوا على عائد يُذكر من استثماراتهم في الذكاء الاصطناعي. و23% فقط من المؤسسات تعمل فعلياً على توسيع نطاق الوكلاء الأذكياء (McKinsey). إذا لم تكن بياناتك جاهزة، أو لم يكن فريقك مدرّباً، أو كانت حالة الاستخدام لديك تسجل أقل من 3، فإن التوقف المدروس لبناء الأسس أحكم من مشروع تجريبي سابق لأوانه. المؤسسات الخليجية التي ستقود في 2027 ليست بالضرورة تلك التي بدأت أبكر — بل تلك التي بدأت بالشكل الصحيح.

- توقعات الإيرادات يجب أن تكون واقعية: تتوقع 62% من المؤسسات الخليجية زيادة لا تتجاوز 1-10% في الإيرادات من الوكلاء الأذكياء (تقرير IDC/e&). القيمة على المدى القريب تكمن في الكفاءة التشغيلية وتخفيض التكاليف، لا في نمو الإيرادات التحوّلي. صمّم دراسة الجدوى وفقاً لذلك.

سؤال واحد نختم فيه

حين تفكر في الوكلاء الأذكياء لمؤسستك، اسأل نفسك: "أيّ سير عمل نشغّله هو الأكثر تكلفةً، وله مدخلات واضحة، ومخرجات واضحة، ومعيار نجاح محدد؟"

تلك هي نقطة البداية. ليست حالة الاستخدام الأكثر إثارة. وليست الرؤية الأكثر طموحاً. بل الأكثر تكلفةً والأوضح تحديداً.

ابدأ من هناك. ابنِ الثقة. ثم وسّع.

احصل على مقالات جديدة

اشترك للحصول على أحدث الأبحاث والأطر المعرفية مباشرة في بريدك.