الذكاء الاصطناعي في قطاع المؤسسات دخل عصر الثقة: ماذا يعني ذلك لمؤسستك؟

تجاوزت قدرات الذكاء الاصطناعي ثقة المؤسسات فيه. قرار Amazon بالمراجعة الإلزامية وإطلاق NVIDIA لـ NemoClaw يؤكدان أن حوكمة الذكاء الاصطناعي لم تعد خياراً — إنها البنية التحتية التي تتيح السرعة.

جاسم النعيمي

باحث في التعاون مع الذكاء الاصطناعي

إعلانان هذا الأسبوع يؤشران أن الذكاء الاصطناعي المؤسسي دخل مرحلة جديدة.

Amazon الآن تشترط مراجعة مهندس برمجيات كبير قبل نشر أي كود يولّده الذكاء الاصطناعي في بيئة الإنتاج.

NVIDIA أطلقت NemoClaw — إطار أمني لعزل الوكلاء الأذكياء والتحكم في صلاحياتهم — مع توقيع 17 شريكاً مؤسسياً عند الإطلاق.

هذا ليس تزامناً. إنه استجابة القطاع المؤسسي لقوة واحدة مشتركة: تجاوزت قدرات الذكاء الاصطناعي ثقة المؤسسات فيه. والثقة أصبحت الشرط الأساسي للمضي قدماً.

ما حدث هذا الأسبوع

قرار Amazon بمراجعة المهندسين الكبار

أعلنت Amazon سياسة رسمية تشترط مراجعة مهندس برمجيات أول للكود الذي يولّده الذكاء الاصطناعي قبل نشره. الرسالة واضحة: الذكاء الاصطناعي يستطيع كتابة الكود، لكن البشر مسؤولون عما يُنشر.

هذا ليس موقفاً معادياً للذكاء الاصطناعي. إنه اعتراف مؤسسي بغياب طبقة المساءلة. الكود الذي يولّده الذكاء الاصطناعي موجود فعلاً في بيئة الإنتاج عبر مئات أنظمة Amazon — السؤال لم يكن أبداً هل نستخدمه، بل كيف نحكمه.

سام ألتمان في قمة BlackRock للبنية التحتية

قدّم الرئيس التنفيذي لـ OpenAI عرضاً في قمة BlackRock للبنية التحتية — مكان ذو دلالة يقع عند تقاطع رأس المال المؤسسي والصناديق السيادية والاستثمار في البنية التحتية الكبرى. الرسالة الضمنية: الذكاء الاصطناعي يُناقش الآن في نفس الغرف التي تُناقش فيها شبكات الطاقة والموانئ والبنية المالية. لقد دخل محادثة البنية التحتية.

المنشور الذي وثّق هذا حقق 91 ألف مشاهدة، مع تفاعل منخفض بشكل لافت نسبة للوصول. هذا نمط استهلاك تصفحي يشير إلى معالجة معلومات، لا ترفيه. الناس تقرأ، لا تُعجب — وهذا بالضبط ما يبدو عليه الثقل الاستراتيجي على وسائل التواصل.

إطلاق NVIDIA NemoClaw

يضيف NemoClaw أمناً مؤسسياً على OpenClaw، إطار الوكلاء الأذكياء مفتوح المصدر الذي تجاوز 250 ألف نجمة على GitHub. تحديداً:

- عزل OpenShell — الوكلاء الأذكياء يعملون في بيئات معزولة لا تستطيع الوصول لأنظمة غير مصرح بها

- ضوابط الشبكة — تقييد الخدمات الخارجية التي يمكن للوكلاء الوصول إليها

- ضمانات الخصوصية — منع الوكلاء الأذكياء من تسريب البيانات الحساسة

- سجلات التدقيق — تتبع كامل لأفعال الوكيل الذكي للامتثال التنظيمي

لخّص أبيل شوي في LinkedIn: "الثقة في الوكلاء الأذكياء مشكلة بنية تحتية، لا مشكلة تطبيق." NemoClaw هو البنية التحتية.

النمط وراء الإعلانات

هناك نمط واحد تحت كل الإشارات الثلاث: المؤسسات تتحول من "هل يمكننا استخدام الذكاء الاصطناعي؟" إلى "كيف نحكمه؟"

هذا هو التحول في المرحلة:

- المرحلة الأولى (2023-2024): تجارب ومشاريع تجريبية. "لنجرّبه."

- المرحلة الثانية (2025): اعتماد ودمج. "أصبح في سير عملنا."

- المرحلة الثالثة (2026): الحوكمة وتصليب بيئة الإنتاج. "يحتاج هياكل مساءلة."

سرّعت حادثة DataTalks.Club هذا التحول — حيث تسبب وكيل ذكي في فقدان بيانات 2.5 سنة. ليس لأنها كانت استثنائية في حدّتها، بل لأنها كانت علنية وموثقة. أعطت فرق المخاطر المؤسسية حالة ملموسة للإشارة إليها.

كل مدير تقني ومدير أمن معلومات يسأل الآن: ما سياسة حوكمة الذكاء الاصطناعي لدينا؟

معظمهم ليس لديهم إجابة.

لماذا السياق المؤسسي أعمق مما يبدو

إذا كنت تقود فريقاً تقنياً أو تتخذ قرارات بشأن نشر الذكاء الاصطناعي، فهذه التحديات ستبدو مألوفة — لأنها تتجاوز ما تعالجه الأطر التقنية الجاهزة:

1. تسارع التنظيم مقابل جاهزية الاعتماد

تتبنى المؤسسات تطبيقات الذكاء الاصطناعي بوتيرة متسارعة، لكن أطر الحوكمة الداخلية — السياسات وإجراءات المراجعة وهياكل المساءلة — لم تواكب هذا التسارع.

هناك فجوة بين "الذكاء الاصطناعي أصبح في سير عملنا اليومي" وبين "لدينا عملية موثقة لنشر وكلاء الذكاء الاصطناعي بأمان."

2. سؤال الرقابة البشرية في ثقافات السياق العالي

في كثير من المؤسسات، العلاقة بين السلطة والمساءلة والتفويض تحمل وزناً عميقاً. حوكمة الذكاء الاصطناعي ليست مجرد سؤال تقني — إنها سؤال تنظيمي وثقافي. من المسؤول حين يتخذ الوكيل الذكي قراراً؟ كيف ينطبق ذلك على هياكل تنظيمية قائمة تُرسم فيها السلطة بخطوط واضحة؟

نموذج Amazon في المراجعة الكبيرة إجابة واحدة. لكنها إجابة مصممة لثقافة Amazon. كل مؤسسة تحتاج نماذج حوكمة تنطبق على هياكل السلطة الخاصة بها.

3. السيادة على البيانات ومتطلبات الخصوصية

ضوابط الشبكة والبيانات في NemoClaw ليست ميزات اختيارية للمؤسسات — إنها متطلبات أساسية. قوانين حماية البيانات الشخصية الإقليمية، وأطر القطاعات المتخصصة والمناطق الحرة المالية، وتوجيهات البنوك المركزية — كلها تُنشئ قيوداً إلزامية يجب أن تحترمها أنظمة وكلاء الذكاء الاصطناعي.

سياسة حوكمة الذكاء الاصطناعي يجب أن تبدأ من الطبقة التنظيمية، لا أن تنتهي بها.

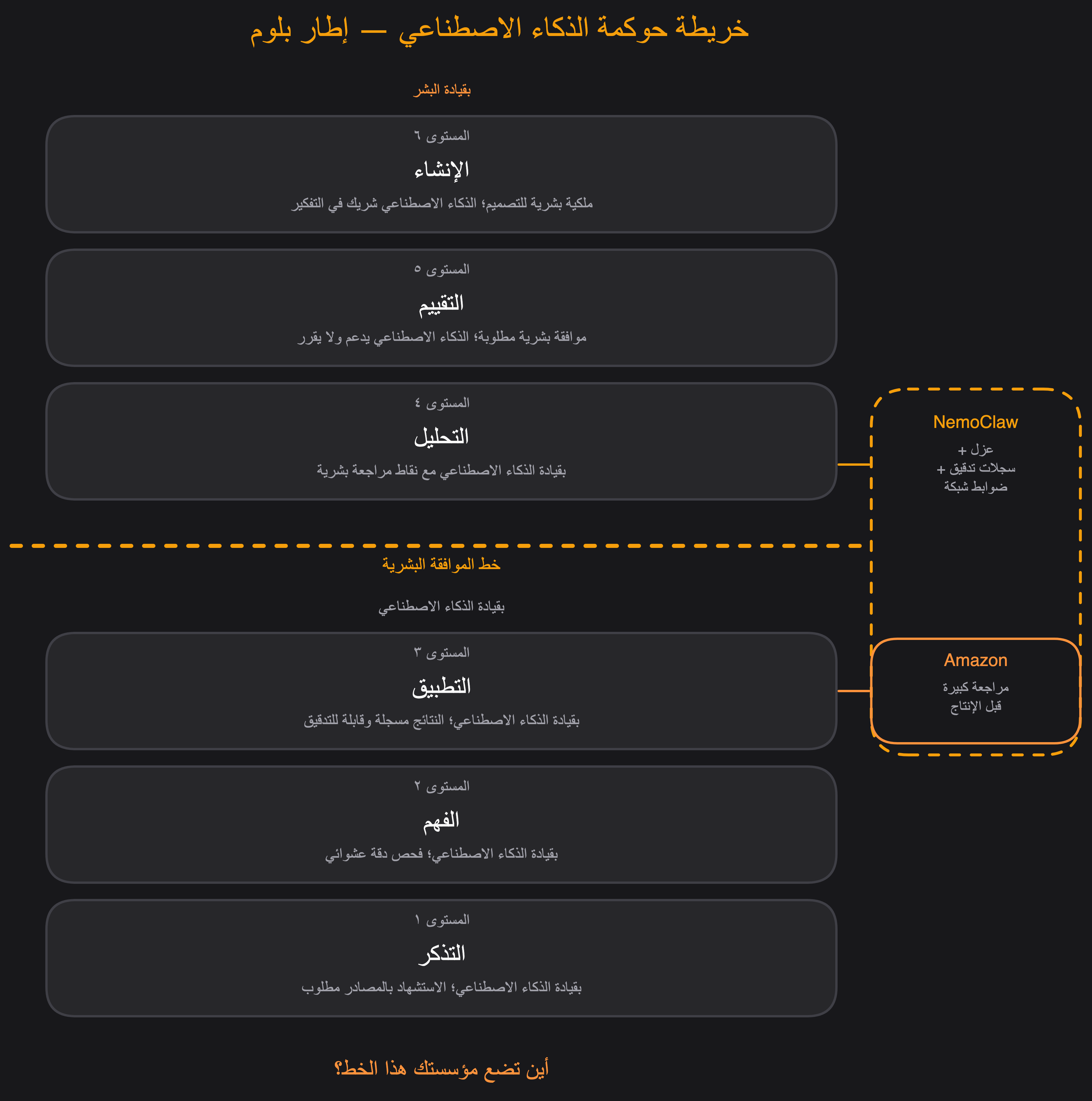

إطار للحوكمة المؤسسية (تطبيق بلوم)

يُخبرنا إطار تعاون بلوم مع الذكاء الاصطناعي بشيء حاسم: السؤال ليس "ما المهام التي يجب أن يؤديها الذكاء الاصطناعي؟" بل "في أي مستوى معرفي يجب أن يبقى البشر في الحلقة؟"

سؤال الحوكمة المؤسسية جوهرياً: عند أي مستوى تشترط موافقة بشرية؟

إجابة Amazon: المستوى 3 (التطبيق) يتطلب مراجعة بشرية كبيرة قبل الإنتاج. إجابة NemoClaw: المستويات 3-4 تتطلب عزلاً وسجلات تدقيق وضوابط شبكة.

إجابة مؤسستك يجب أن تكون موثقة، لا مفترضة.

الأسئلة الخمسة التي تحتاج كل مؤسسة للإجابة عنها

إذا كنت تبني سياسة حوكمة للذكاء الاصطناعي المؤسسي في 2026، فهذه الأسئلة الخمسة هي التي تهم:

1. حدود المساءلة: حين يتخذ الذكاء الاصطناعي قراراً أو يؤثر فيه ويتسبب في ضرر، من المسؤول؟ (أجب عن هذا قبل النشر، لا بعد وقوع حادثة.)

2. عتبات المراجعة: عند أي مستوى معرفي يتطلب ناتج الذكاء الاصطناعي موافقة بشرية قبل التصرف؟ (اربط هذا بمستويات بلوم — يفرض الدقة.)

3. ضوابط الوصول للبيانات: ما الأنظمة التي يستطيع وكلاء الذكاء الاصطناعي لمسها وقراءتها وكتابتها؟ (ضوابط الشبكة في NemoClaw هي التنفيذ التقني لسؤال السياسة هذا.)

4. التدقيق والتسجيل: هل تستطيع إعادة بناء ما فعله وكيل الذكاء الاصطناعي ومتى ولماذا؟ (مطلوب للامتثال التنظيمي؛ ومطلوب للاستجابة للحوادث في كل مكان.)

5. مسار التصعيد: حين يواجه وكيل الذكاء الاصطناعي غموضاً أو مخاطرة أو وضعاً خارج السياسة، ماذا يحدث؟ (معظم سياسات الحوكمة تفشل هنا — تُعرّف العمليات العادية لكن ليس الحالات الحدية.)

الفرصة في الفجوة

هذه هي الحقيقة الاستراتيجية: المؤسسات التي تبني البنية التحتية للحوكمة الآن — قبل أن تفرضها الحوادث — ستمتلك ميزة هيكلية.

ستنشر الوكلاء الأذكياء في الإنتاج بشكل أسرع، لأن البنية التحتية للثقة جاهزة. ستواجه مفاجآت امتثال تنظيمي أقل، لأن ضوابط البيانات مدمجة. ستجذب شراكات أفضل، لأن الشركاء يريدون العمل مع من لديهم حوكمة موثقة.

لم تبنِ Amazon وNVIDIA البنية التحتية للحوكمة من أجل التباطؤ. بل لتتحرك بشكل أسرع، بأمان.

هذه هي إعادة التأطير: حوكمة الذكاء الاصطناعي ليست المكبح. إنها حزام الأمان الذي يتيح لك القيادة بأقصى سرعة.

السؤال الآن ليس هل تحتاج مؤسستك إلى سياسة حوكمة — بل متى ستبدأ ببنائها؟

احصل على مقالات جديدة

اشترك للحصول على أحدث الأبحاث والأطر المعرفية مباشرة في بريدك.